آخر الأخبار

ميتا تُجمد خططها لاستخدام بيانات المستخدمين في برنامج ذكاء اصطناعي

أعلنت شركة ميتا، المالكة لمنصتي فيسبوك وإنستجرام، في خطوة مفاجئة، عن تعليق خططها لاستخدام بيانات المستخدمين الشخصية في برنامج ذكاء اصطناعي واسع النطاق.

ويأتي هذا القرار بعد تلقي الشركة لانتقادات واسعة من قبل جهات تنظيمية أوروبية، حيث أعربت عن مخاوفها بشأن مخاطر الخصوصية المرتبطة بمشروع ميتا الطموح.

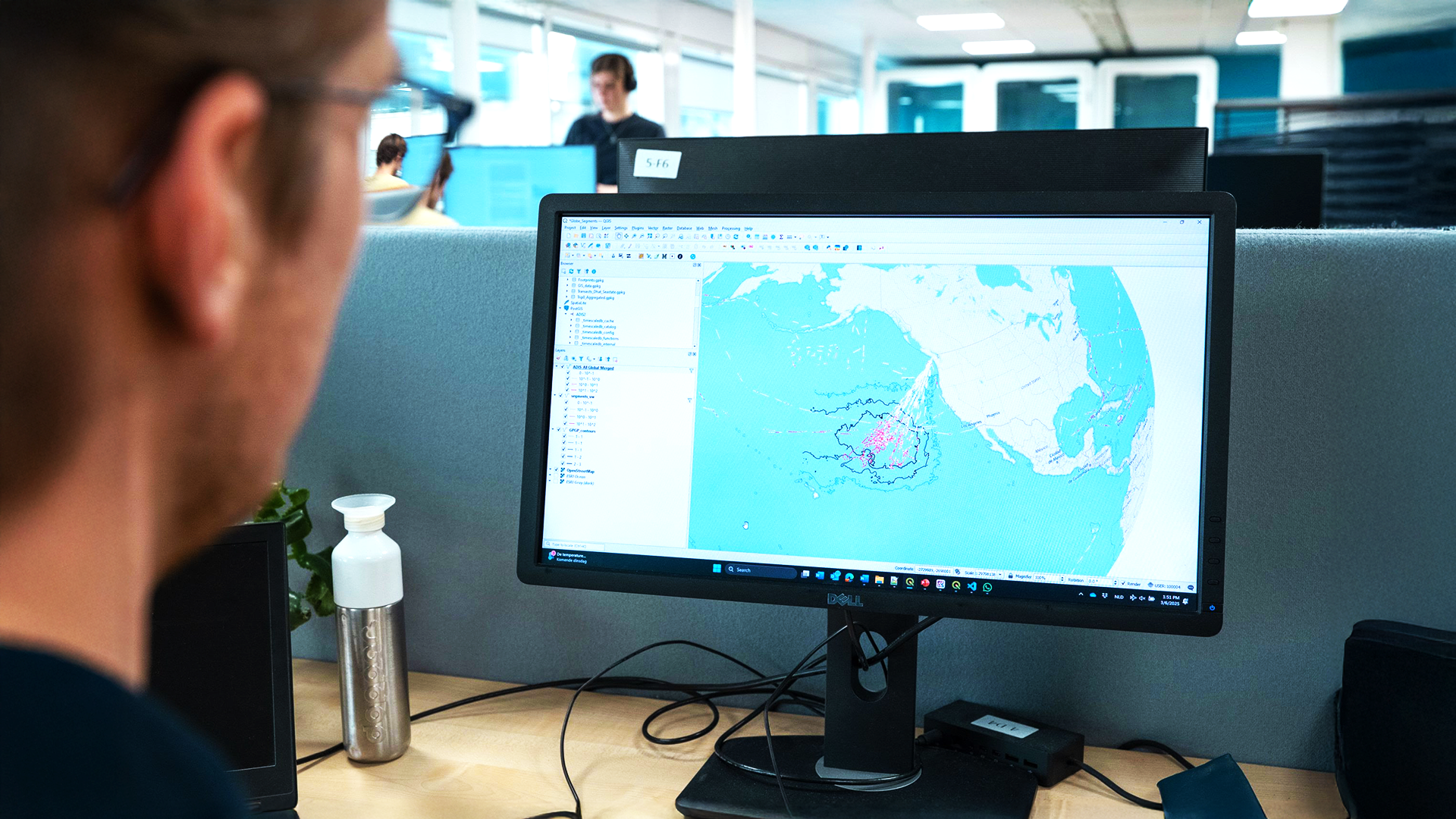

فقد كانت ميتا تخطط لتطوير نموذج لغة ضخم يُعرف باسم “LaMDA” باستخدام بيانات المستخدمين، بهدف تحسين قدراتها على التعرف على النصوص والصور ومقاطع الفيديو بشكل أكثر دقة وفعالية.

وتُستخدم نماذج اللغة الضخمة في العديد من التطبيقات، بما في ذلك الترجمة الآلية والكتابة الإبداعية وتطوير برامج المساعد الافتراضي، ولديها القدرة على إحداث ثورة في العديد من المجالات.

ولكن، أثار مشروع ميتا مخاوف بشأن إمكانية استخدام بيانات المستخدمين الشخصية لأغراض غير مرغوب فيها، مثل استهدافهم بالإعلانات المُخصصة أو التلاعب بآرائهم، خاصةً مع الأخذ بعين الاعتبار السجل الحافل للشركة في مجال انتهاكات الخصوصية.

وتُعد هذه الخطوة انتكاسة كبيرة لميتا، التي تسعى جاهدة لتعزيز مكانتها في مجال الذكاء الاصطناعي وتطوير تقنيات جديدة تُساهم في تحسين تجربة المستخدمين.

وتُواجه الشركة منافسة قوية من شركات أخرى مثل جوجل ومايكروسوفت، اللتان تستثمران بكثافة في مجال الذكاء الاصطناعي وتُقدمان حلولًا مبتكرة تحظى بثقة المستخدمين.

وتُشير هذه التطورات إلى تزايد قلق المنظمين والمستخدمين بشأن مخاطر الخصوصية المرتبطة بتقنيات الذكاء الاصطناعي،خاصةً مع ازدياد الاعتماد على البيانات الشخصية لتطوير هذه التقنيات.

ومن المرجح أن تُلزم هذه المخاوف الشركات بتغيير نهجها في تطوير واستخدام تقنيات الذكاء الاصطناعي في المستقبل، مع التركيز على ضمان الشفافية وحماية البيانات الشخصية للمستخدمين.

وإلى جانب تعليق مشروع “LaMDA” ، أعلنت ميتا أيضًا عن أنها ستُراجع سياساتها الخاصة بالبيانات والخصوصية بشكل شامل.

وتُعد هذه الخطوة ضرورية لتعزيز ثقة المستخدمين وكسب موافقة الجهات التنظيمية، خاصةً في ظلّ التطورات الأخيرة في مجال الخصوصية وحماية البيانات.

وتُواجه ميتا تحديات كبيرة في مجال الذكاء الاصطناعي، ولكن لديها أيضًا فرصة لتصبح رائدة في تطوير تقنيات ذكية وآمنة تُحترم خصوصية المستخدمين وتُلبي احتياجاتهم بشكل أفضل.

وتتطلب هذه المهمة من الشركة مراجعة شاملة لسياساتها وممارساتها، والتعاون مع الجهات التنظيمية والخبراء في مجال الخصوصية، والتركيز على بناء الثقة مع المستخدمين من خلال الشفافية والمساءلة.

وبشكل عام، تُمثل خطوة ميتا تعليق مشروع “LaMDA” نقطة تحول هامة في مجال الذكاء الاصطناعي، وتُسلط الضوء على أهمية مراعاة مخاطر الخصوصية عند تطوير هذه التقنيات.

وإنّ مستقبل الذكاء الاصطناعي يعتمد على قدرة الشركات على التوفيق بين الابتكار وحماية البيانات الشخصية، وضمان استخدام هذه التقنيات بشكل مسؤول وأخلاقي.